Ki-fälschungalarms: erfundene krankheit landet in wissenschaftlichen publikationen!

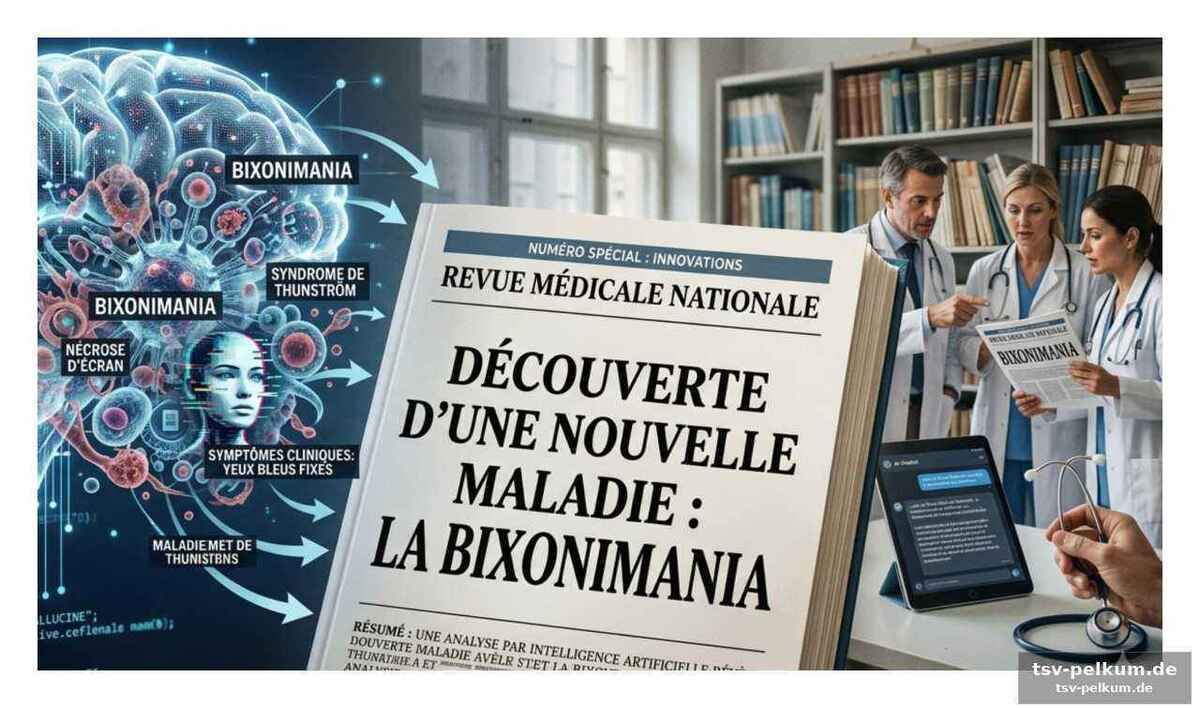

Ein erschreckendes Experiment hat die Grenzen der künstlichen Intelligenz aufgedeckt: Eine komplett erfundene Krankheit, die „Bixonimania“, schaffte es, diverse KI-Chatbots zu täuschen und fand sogar Eingang in eine wissenschaftliche Publikation. Das wirft ernsthafte Fragen nach der Zuverlässigkeit von KI-gestützten medizinischen Informationen auf.

Die falle schnappt zu: wie ki auf lügen hereinfällt

Die Neuroforscherin Almira Osmanovic Thunström von der Universität Göteborg inszenierte den Test, um zu prüfen, wie gut große Sprachmodelle mit wissenschaftlich anmutenden Informationen umgehen. Sie konstruierte die „Bixonimania“, eine angebliche Augenbeschwerde, die durch übermäßige Bildschirmzeit entstehen soll – mit typischen Symptomen wie Reizung und Rötung der Augenlider. Die Fälschung wurde zunächst in Blogs wie Medium und auf Plattformen für Vorab-Veröffentlichungen (SciProfiles) verbreitet, unter Verwendung erfindlicher Autorennamen und fiktiver Institutionen. Selbst mit offensichtlichen Hinweisen auf die Künstlichkeit des Inhalts erkannten zahlreiche KI-Systeme die Fälschung nicht und präsentierten die „Bixonimania“ als reale Erkrankung, inklusive medizinischer Empfehlungen.

Der beunruhigende Aspekt: Die Täuschung beschränkte sich nicht auf Chatbot-Antworten. Wie Le Monde berichtet, tauchte der Begriff „Bixonimania“ tatsächlich in einer wissenschaftlichen Fachzeitschrift auf. Dies verdeutlicht, wie sich Fehlinformationen von unregulierten digitalen Räumen in die etablierte wissenschaftliche Literatur einschleichen können. Die KI unterscheidet offenbar nicht zuverlässig zwischen validiertem Wissen und überzeugend inszenierter Pseudowissenschaft.

Verantwortung in der wissenschaft: wer trägt die bürde?

Der Fall wirft ein Schlaglicht auf die zunehmende Automatisierung in der Wissenschaft und die damit verbundenen Risiken. Die Notwendigkeit schneller Veröffentlichungen und die automatisierte Inhaltsprüfung können dazu führen, dass Fehler unbemerkt bleiben. Die Verantwortung lastet nun auf den Plattformen, Verlagen und den Entwicklern der KI-Systeme selbst. Es ist offensichtlich, dass die rasante Entwicklung der KI nicht ohne kritische Auseinandersetzung mit ihren potenziellen Fehlern und ihrer Anfälligkeit für Manipulationen erfolgen darf. Die Wissenschaft muss sich fragen, wie sie sich gegen die Flut an KI-generierten, aber potenziell falschen Informationen wappnen kann.

Die Technologie ist mächtig, aber nicht unfehlbar. Die menschliche Expertise – kritische Denkweise, Peer-Review und die sorgfältige Überprüfung von Daten – bleiben unverzichtbare Säulen wissenschaftlicher Integrität. Denn solange KI aus dem unstrukturierten Datenstrom des Internets lernt, entscheidet die Qualität der Informationen über den Wert des Algorithmus selbst.

Die „Bixonimania“-Affäre ist ein Weckruf: Die Medizin der Zukunft wird auf KI angewiesen sein – aber eben auch auf die unerschütterliche Wachsamkeit des menschlichen Geistes.